[지디넷코리아]

알리바바클라우드가 이미지 생성 모델에 이어 영상 생성 모델을 공개하며 개인 크리에이터도 연출 수준의 영상 제작 전 과정을 직접 제어할 수 있는 환경을 지원한다.

알리바바클라우드는 통합 영상 생성 모델 ‘완(Wan)2.7-비디오’를 8일 공개했다. 이번 모델은 텍스트 기반 영상 생성(t2v), 이미지 기반 영상 생성(i2v), 레퍼런스 기반 영상 생성(r2v), 영상 편집(videoedit) 등 4개 모델로 구성된다. 텍스트·이미지·영상·오디오 입력을 하나의 통합된 시스템 안에서 처리한다.

서사적 일관성과 멀티 샷 간 일관성에서 존재하던 기존 한계를 해소하고, 스크립트 입력부터 이미지 제어까지 다양한 제작 과정을 하나의 흐름 안에서 처리할 수 있도록 했다. 영상 길이는 2초~15초, 해상도는 720p·1080p를 지원하며 엔터프라이즈 응용 프로그램 인터페이스(API)를 통한 대량 처리와 맞춤형 워크플로우 구성도 가능하다.

핵심은 자연어 기반 편집 기능이다. 완2.7-비디오는 기존 영상 후반 작업의 높은 비용 구조를 해소하기 위해 캐릭터 동작·대사·외형, 장면 스타일, 촬영 구도 등 영상의 대부분 요소를 텍스트 명령으로 수정할 수 있도록 했다. 다양한 카메라 움직임으로 촬영 구도를 빠르게 재구성하면서도 일관된 조명 조건을 유지하며 스크립트 변경 시 입 모양과 음성을 자동 동기화해 각 캐릭터 고유의 음성 특성을 살린 자연스러운 대사 편집이 가능하다.

멀티모달 입력 기반으로 오디오를 활용해 날씨를 변경하거나 다중 이미지 입력으로 스토리 방향·카메라 구도·캐릭터 설정을 세밀하게 조정할 수도 있다. 최대 5개 캐릭터에 각각 고유한 음성 톤과 시각적 정체성을 부여해 복잡한 서사 전반에서 일관성을 유지하며, 50개 이상의 감정 표현과 수천 가지 스타일 조합을 지원한다.

스토리텔링 기능도 강화됐다. 완2.7-비디오의 내러티브 엔진은 지능형 스케줄링을 기반으로 단일 프롬프트 입력만으로 FPV 드론 시점, 360도 회전 샷, 맥락 기반 조명 연출 등이 포함된 다중 스토리보드와 장면 전환 리듬을 갖춘 완성형 스토리보드를 자동 생성한다. 정렬된 영상 편집 데이터로 학습된 이 모델은 자연어와 레퍼런스 이미지를 기반으로 콘텐츠를 정밀하게 재구성하는 새로운 엔드투엔드 아키텍처를 적용했다. 사용자가 종료 프레임을 직접 지정하는 영상 이어 생성 기능으로 장면 간 급격한 끊김 현상을 최소화한다.

알리바바클라우드는 완2.7-비디오 공개에 앞서 이미지 생성 모델 ‘완2.7-이미지’도 선보였다. 이 모델은 기존 인공지능(AI) 이미지에서 나타났던 획일적인 시각 표현과 일관되지 않은 색상 재현 문제를 해결하기 위해 설계된 도구다.

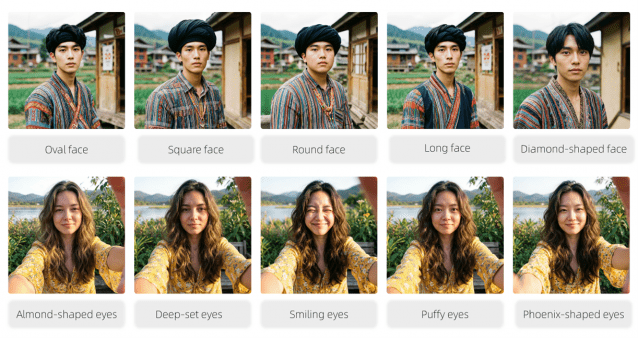

핵심 기능으로는 골격 구조와 눈 모양 등 캐릭터의 세부 특성을 정밀하게 조정할 수 있는 개인화 엔진과, 색상 코드 기반으로 브랜드 색상을 정확하게 구현하는 ‘컬러 팔레트’ 기능이 포함된다. 또 3000토큰 규모의 컨텍스트 처리 능력을 기반으로 12개 언어에서 인쇄 품질의 학술 텍스트, 복잡한 수식, 표를 생성할 수 있으며 언어적 의도와 시각적 표현 간의 간극을 해소했다.

영상 및 이미지 모델은 알리바바클라우드의 모델 스튜디오와 완 공식 웹사이트를 통해 이용할 수 있으며 큐원 앱에도 통합될 예정이다. 알리바바클라우드 측은 “최신 이미지 생성 모델 완2.7 이미지 공개 직후 영상 모델을 출시하며 멀티미디어 AI 역량 확장을 본격화하고 있다”고 말했다.