[지디넷코리아]

“완전히 안전쇼다.”

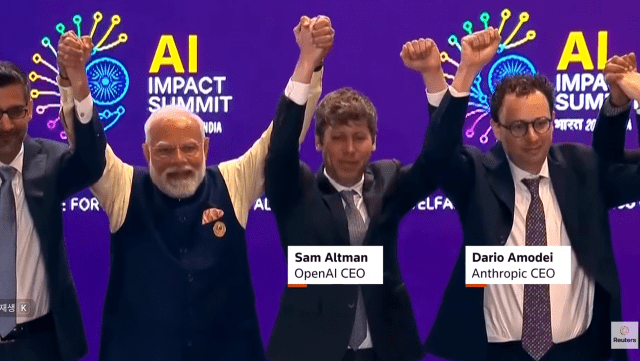

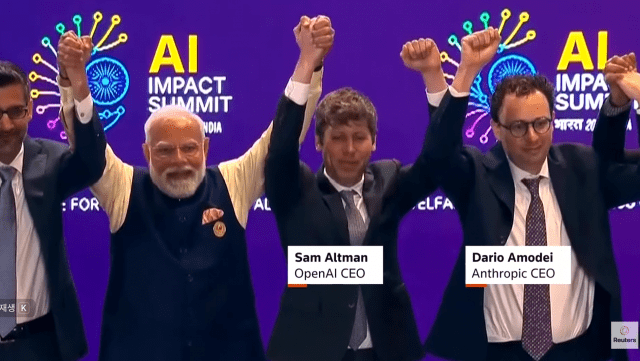

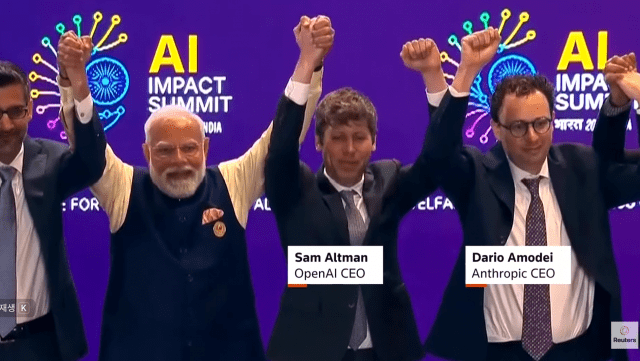

다리오 아모데이 앤트로픽 최고경영자(CEO)가 오픈AI를 강하게 비판했습니다. 최근 오픈AI가 미국 국방부와 인공지능(AI) 공급 계약 체결한 것을 겨냥한 발언입니다. 자신들을 배제한 국방부가 곧바로 오픈AI 손을 잡았으니 감정이 좋을 리는 없겠지요.

‘안전쇼(safety theater)’란 표현은 미국 보안 전문가 브루스 슈나이어가 ‘두려움을 넘어서(Beyond Fear)’란 책에서 제시한 개념입니다. 안전 강화 효과는 거의 없으면서 대중에게는 안전해졌다는 인상만 주는 보여주기식 보안 조치를 의미합니다. 말 그대로 ‘안전을 연출하는 행위’라는 비판적 표현입니다.

슈나이어가 자주 언급한 사례 중 하나가 공항의 액체류 반입 제한입니다. 여러 액체를 재조합하면 위험한 물질을 만들 수 있기 때문입니다. 거창하게 검색을 하지만 실제 테러 예방 효과는 제한적이라는 지적입니다.

9·11 직후 미국 공항에 방위군이 배치된 일도 있습니다. 하지만 이들이 들고 있던 총에는 실탄이 없었습니다. 슈나이어는 이런 조치 역시 ‘안전쇼’라고 비판했습니다. 실제 테러 대응 능력은 없지만 승객들에게는 “보안이 강화됐다”는 인상을 주기 때문입니다.

아모데이가 오픈AI를 향해 ‘안전쇼’란 표현을 꺼낸 이유도 이와 비슷합니다.

쟁점은 미국 국방부와의 AI 계약입니다. 앤트로픽은 국방부와 협상을 진행하면서 “모든 합법적 용도(any lawful use)에만 사용하도록 하라”는 조건을 요구했습니다. 계약서에 명확한 레드라인을 설정하자는 취지였습니다.

대표적인 금지 항목은 세 가지였습니다.

첫째, 완전 자율 살상 무기

둘째, 대규모 국내 감시

셋째, 인간 통제 없이 작동하는 군사 AI

하지만 국방부는 이런 제한을 완화해 달라고 요구했습니다. 앤트로픽은 이를 거부했고, 결국 협상은 결렬됐습니다. 이후 국방부는 앤트로픽을 ‘공급망 위험’ 기업으로 지정하고 대신 오픈AI와 계약을 체결했습니다.

문제는 계약 문구입니다.

앤트로픽과 협상할 때 사용됐던 표현은 ‘모든 합법적 용도(any lawful use)’였습니다. 반면 오픈AI와의 계약에는 ‘모든 합법적 목적(all lawful purposes)”이란 문구가 들어갔습니다. 용도(use)가 목적(purpose)으로 좀 더 포괄적으로 바뀐 겁니다.

이렇게 되면 해석의 여지가 커집니다. 합법적인 목적이란 조건만 충족할 경우 감시, 군사 작전, 기타 군사적 활용에도 AI를 사용할 수 있다는 해석이 가능해지기 때문입니다.

아모데이가 이를 ‘안전쇼’라고 비판한 이유가 바로 여기에 있습니다.

물론 오픈AI도 반박했습니다. 국방부와 협상하면서 “국내 감시에 우리 기술을 사용하는 것은 불법이며, 그런 용도로는 사용하지 않도록 계약서에 명확히 했다”는 입장입니다.

하지만 비판론자들은 다른 문제를 지적합니다. 법은 언제든 바뀔 수 있다는 겁니다. 지금은 불법으로 간주되는 일도 앞으로는 합법이 될 수 있다는 것입니다.

두 회사의 엇갈린 선택은 사실 놀라운 일은 아닙니다. AI 개발을 바라보는 철학 자체가 다르기 때문입니다.

앤트로픽 핵심 경영진은 원래 오픈AI 출신입니다. 공동 창업자인 다리오 아모데이는 오픈AI 연구 책임자(VP of Research)를 맡았던 인물입니다. 그러나 내부 갈등 끝에 결국 회사를 떠나게 됩니다.

갈등의 배경에는 세 가지 요인이 있었습니다.

첫째는 개발 속도입니다. 샘 알트먼은 AI 개발을 최대한 빠르게 추진해야 한다는 입장이었습니다. 반면 아모데이는 “AI가 너무 빠르게 발전하면 위험하다”며 통제 가능한 개발을 강조했습니다.

둘째는 상업화 문제입니다. 오픈AI는 원래 ‘인류를 위한 AI’를 목표로 출발한 비영리 연구기관이었습니다. 하지만 마이크로소프트 투자 유치 이후 상업화가 빠르게 진행됐습니다. 내부에서는 “AI 개발이 지나치게 기업 중심으로 흐르고 있다”는 비판도 제기됐습니다.

셋째는 AI 위험에 대한 인식입니다. 아모데이는 AI의 잠재적 위험을 매우 심각하게 보는 인물입니다. 그는 AI가 인간보다 뛰어난 지능을 갖게 될 가능성뿐 아니라 ▲생물무기 설계 지원 ▲사이버 공격 자동화 ▲사회적 조작 ▲대량 실업 같은 문제도 꾸준히 경고해 왔습니다.

결국 아모데이 등은 2021년 오픈AI를 떠나 앤트로픽을 창업합니다. 그리고 ‘안전한 AI(Safe AI)’를 회사의 핵심 목표로 내세웁니다.

이런 배경을 보면 국방부 계약을 둘러싼 논쟁도 조금 더 이해하기 쉬워집니다. 앤트로픽 입장에서는 군사적 활용 가능성이 있는 AI 계약을 쉽게 받아들이기 어려웠을 겁니다. 오픈AI 시절부터 유지해 온 개발 철학과도 정면으로 충돌하기 때문입니다.

반면 오픈AI는 다른 판단을 내린 것으로 보입니다. “합법적 목적에만 사용한다”는 조건과 안전 장치만으로도 AI 남용을 충분히 통제할 수 있다고 본 것입니다.

두 회사의 철학을 한 줄로 정리하면 이렇습니다.

오픈AI = move fast

앤트로픽 = move carefully

국방부 계약을 둘러싼 공방 역시 이 철학 차이의 연장선에서 나온 논쟁입니다.

그렇다면 오픈AI가 내세운 안전 장치는 과연 실질적인 보호 장치일까요. 아니면 아모데이의 주장처럼 ‘안전쇼’에 불과한 걸까요.

여러분은 어떻게 생각하십니까.