[지디넷코리아]

정부의 ‘독자 인공지능(AI) 파운데이션 모델(독파모)’ 개발에 참여하는 4개 팀이 오는 8월 중 2차 단계평가를 앞둔 가운데, 업스테이지가 차세대 오픈소스 모델에서 전작 대비 2~3배 성능 향상을 확보한 것으로 나타났다.

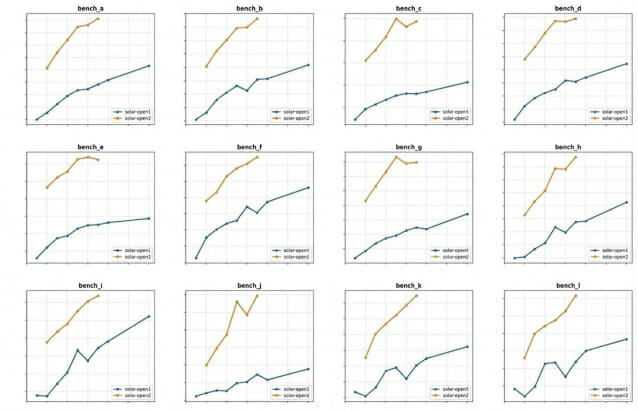

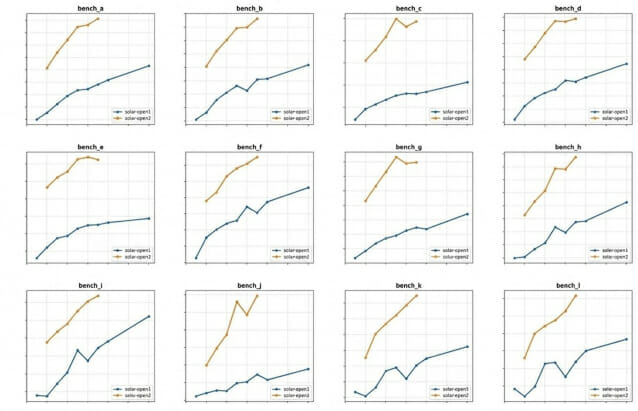

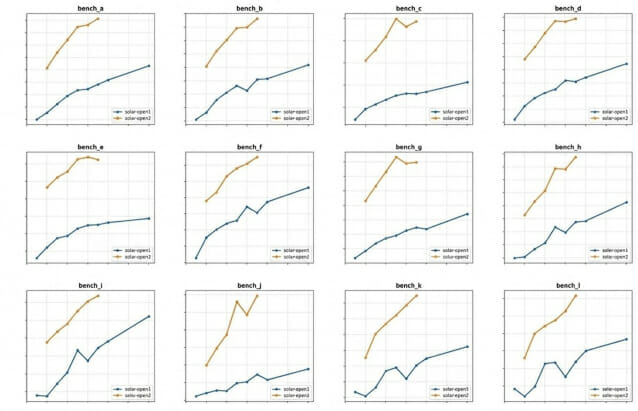

17일 업계에 따르면 김성훈 업스테이지 대표는 전날 자신의 사회관계망서비스(SNS)를 통해 “솔라 오픈2의 어블레이션(ablation, 절제 실험) 결과 솔라 오픈1 대비 2~3배 더 좋은 성능을 보이고 있다”고 밝혔다.

어블레이션은 모델 구성 요소를 하나씩 제거하거나 변경하며 성능 변화를 검증하는 방식으로 최종 출시 전 설계 선택의 타당성을 확인하는 핵심 공정이다. 솔라 오픈 2는 아직 공개 전이지만 성능 수치가 가시화됐다는 점에서 개발이 상당 단계에 진입한 것으로 해석된다.

업스테이지는 솔라 오픈2 개발을 비롯한 독파모 사업 과제를 위해 사후 학습(포스트 트레이닝)·시각언어모델(VLM) 등 관련 직군 채용을 진행하고 있다. 특히 김 대표가 “포스트 트레이닝이나 검증 가능한 보상 기반 강화학습(RLVR) 경험이 있는 분들을 환영한다”고 언급한 만큼 이들 기법을 솔라 오픈2 개발에도 적극 활용할 것으로 보인다.

RLVR은 수학·코딩처럼 정답이 명확한 문제에서 모델이 정답을 맞히면 보상을 주는 방식으로 추론 성능을 높이는 기법으로 딥시크 등이 성능 도약의 발판으로 활용해 주목받았다. 포스트 트레이닝은 사전 학습을 마친 모델이 사용자 명령을 이해하고 실제 서비스에 활용될 수 있도록 추가 학습시키는 과정으로 지도 학습 기반 미세조정(SFT)·강화학습 등이 대표적 기법이다.

업스테이지는 독파모 1단계에서 매개변수 1000억 개 규모의 ‘솔라 오픈 100B’를 선보였다. 이 모델은 비교적 적은 매개변수로 대규모 모델 수준의 성능을 구현하는 효율 중심 전략을 내세우며, 1차 단계평가 중 세계 개별 벤치마크 부문에서 만점(10점 만점)을 획득했다. 해당 평가에서 만점을 받은 팀은 업스테이지와 LG AI연구원 뿐이다. 솔라 오픈2도 이 같은 경량 고성능 전략을 계승하면서 추론 능력을 대폭 강화할 것으로 예상된다.

독파모 사업은 지난해 8월 과학기술정보통신부가 세계적인 AI 모델 의존으로 인한 기술·문화·경제 안보적 종속 문제를 해소하기 위해 출범시킨 국가 프로젝트다. 최초에 선정된 5개 정예 팀이 경쟁을 벌였으며 지난 1월 1차 평가 결과 발표에서 LG AI연구원·SK텔레콤·업스테이지 3개 팀이 2단계에 진출했다. 당시 네이버클라우드는 독자성 미충족, NC AI는 종합 점수 미달로 각각 탈락하게 되면서 지난달 추가 공모를 통해 모티프테크놀로지스가 합류했다.

앞서 독파모 1단계에서 업스테이지 ‘솔라 오픈 100B’·LG AI연구원 ‘K-엑사원-236B’·SK텔레콤 ‘A.X K1’은 미국 비영리 AI 연구기관 ‘에포크(Epoch) AI’의 ‘주목할 만한 AI 모델’에 등재된 데 이어 허깅페이스 트렌딩 모델 첫 페이지에 동시에 오르며 글로벌 주목을 받았다. 클렘 들랑그 허깅페이스 최고경영자(CEO)가 태극기 이모티콘을 붙여 세 모델을 직접 홍보하며 한국 오픈소스 AI의 약진을 알린 것도 이때다.

김 대표는 지난 1월 1차 단계평가 결과 발표 이후 “4개월 학습으로 만든 모델이 이 정도 성능인데 2년간 독파모 프로젝트가 진행된다면 어떤 모델들이 나올지 벌써 설레고 기대가 된다”며 “글로벌에서 우뚝 선 프런티어 모델들이 쏟아져 나올 것”이라고 말했다.